Historia: Estafador Chino Usa Inteligencia Artificial para Engañar a Empresario.

En un caso de estafa tecnológicamente avanzado, un estafador en China ha explotado la tecnología de inteligencia artificial para engañar a un empresario y persuadirlo para que le entregue millones de yuanes.

Este incidente subraya la creciente preocupación en torno a los usos maliciosos de la inteligencia artificial y plantea cuestiones urgentes sobre la seguridad y la regulación de estas tecnologías emergentes.

La Estafa: Un Cambio de Cara y Voz

La víctima de la estafa, de apellido Guo, recibió una videollamada que parecía ser de un amigo cercano.

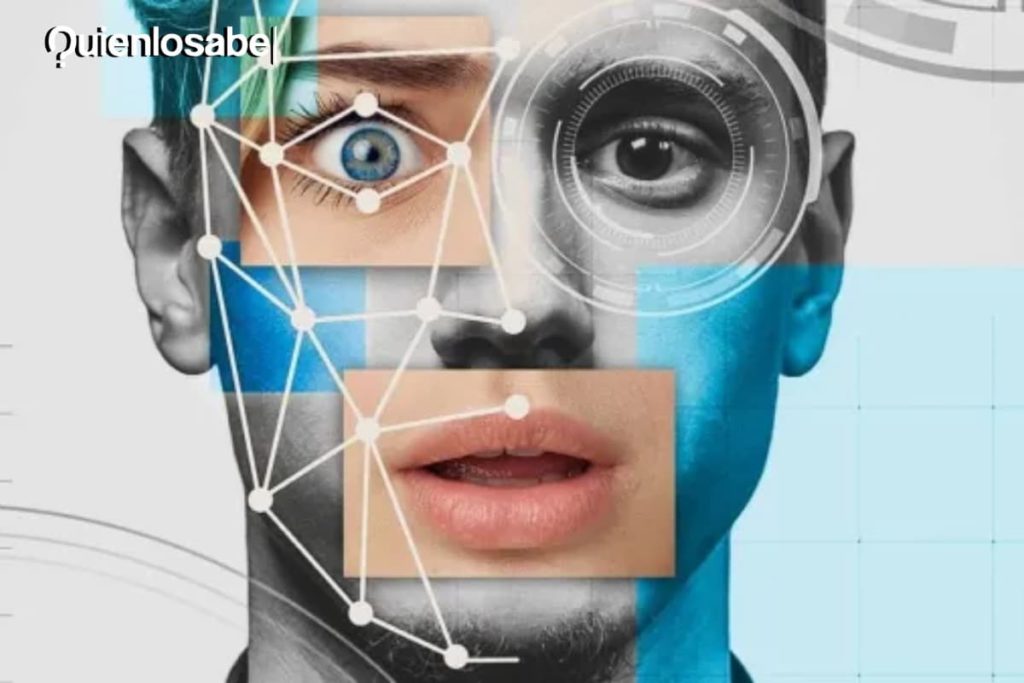

Sin embargo, el llamante era en realidad un estafador que utilizó la tecnología de inteligencia artificial para cambiar su rostro y voz.

El estafador, disfrazado de amigo de Guo, consiguió convencerlo para que transfiriera 4.3 millones de yuanes (609.000 dólares) a su cuenta.

Esto se logró bajo el pretexto de que otro amigo necesitaba sacar el dinero de la cuenta bancaria de una empresa para pagar la garantía de un concurso público.

Guo envió dos pagos desde la cuenta de su empresa por un total de la cantidad solicitada, sin verificar que había recibido el dinero en su cuenta personal.

El estafador envió una captura de pantalla falsificada de un registro de pago para engañar al empresario.

Los Peligros de la IA y los ‘Deepfakes’

Este incidente pone de manifiesto los riesgos asociados con el mal uso de la tecnología de inteligencia artificial.

Los ‘deepfakes‘, imágenes o vídeos creados con inteligencia artificial que pueden manipular o falsificar la realidad, están siendo utilizados con fines maliciosos, incluyendo la difusión de noticias falsas y la perpetración de estafas.

Regulación de la IA en China

En respuesta a estos riesgos, China ha introducido legislación que prohíbe el uso de tecnología ‘deepfake’ para producir, publicar o difundir noticias falsas

Un proyecto de ley recientemente propuesto requeriría que todos los nuevos productos de IA se sometan a una “evaluación de seguridad” antes de ser lanzados al público.

Las Ambiciones de China en la IA

China tiene planes ambiciosos para convertirse en líder mundial en inteligencia artificial para 2030, y empresas como Alibaba, JD.com, NetEase y ByteDance, la matriz de TikTok, se están apresurando a desarrollar productos de IA.

Aunque el chatbot estadounidense ChatGPT de OpenAI no está disponible en China, los usuarios chinos están recurriendo a redes privadas virtuales para acceder a él, demostrando la creciente demanda y el interés en esta tecnología.

Los Riesgos y el Potencial de la IA

El caso de Guo es un ejemplo claro de cómo la tecnología de inteligencia artificial puede ser utilizada para fines nefastos, poniendo de manifiesto la necesidad de una regulación más estricta y efectiva.

Sin embargo, también destaca el potencial de la IA y su creciente papel en la sociedad, lo que significa que la gestión de sus riesgos será una parte crucial de su futuro desarrollo.

Ingeniería Social: La Manipulación Humana en el Ciberespacio

En el contexto de la ciberseguridad, la ingeniería social se refiere a la manipulación de personas para que divulguen información confidencial o realicen acciones que puedan comprometer la seguridad de sus sistemas o datos.

En lugar de explotar vulnerabilidades en el software o el hardware, los estafadores que emplean técnicas de ingeniería social se aprovechan de las vulnerabilidades humanas, como la confianza, la cortesía, la ingenuidad o el miedo.

Las Tácticas de Ingeniería Social

Las tácticas de ingeniería social pueden variar desde simples solicitudes de información hasta elaborados engaños y manipulaciones.

Por ejemplo, un estafador puede llamar a un empleado y hacerse pasar por un técnico de soporte de IT, pidiéndole su contraseña para “solucionar un problema”.

O también, podrían enviar un correo electrónico falso de phishing que parece ser de un banco, pidiendo al destinatario que confirme sus datos de inicio de sesión.

IA y la Ingeniería Social: Un Nuevo Nivel de Engaño

La noticia de la estafa en China representa un caso de ingeniería social llevado al siguiente nivel con el uso de la inteligencia artificial.

El estafador no sólo se hizo pasar por un amigo de la víctima, sino que también utilizó la tecnología de inteligencia artificial para imitar la cara y la voz de ese amigo.

Esta sofisticada manipulación hizo que el engaño fuera mucho más convincente, superando los límites de las estafas tradicionales de ingeniería social.

Las Implicaciones para la Ciberseguridad

Este incidente destaca la creciente amenaza de las técnicas de ingeniería social amplificadas por la inteligencia artificial.

A medida que las herramientas de IA se vuelven más accesibles y sofisticadas, es probable que veamos un aumento en este tipo de ataques.

Esto plantea la necesidad de una mayor conciencia de la ciberseguridad, tanto en términos de protección tecnológica como de educación y capacitación para individuos y organizaciones.

Deberíamos estar preparados para un mundo en el que no sólo los sistemas informáticos, sino también nuestras propias percepciones y relaciones humanas, pueden ser objeto de ataque.

También te podría interesar:

El avión no tripulado de Líbano derribado por Israel: Una mirada más cercana.

El Futuro de Kylian Mbappé es Incierto: Rumores y Realidades.

Historia: Estafador Chino Usa Inteligencia Artificial para Engañar a Empresario.